A finales de junio de este mismo año, GitHub, la conocida plataforma para versionar y compartir código, anunciaba el lanzamiento de una nueva herramienta: Copilot. Esta herramienta consta de una Inteligencia Artificial, enseñada a partir de los miles de millones de líneas de código que los usuarios tienen en su plataforma, capaz de escribir código y programar sin que el usuario tenga que hacer nada más que escribir las primeras líneas del código. Por supuesto, esta herramienta no iba a estar libre de polémica. Pero esta polémica ha llegado hasta el punto de que la Free Software Foundation la ha considerado hasta «ilegal».

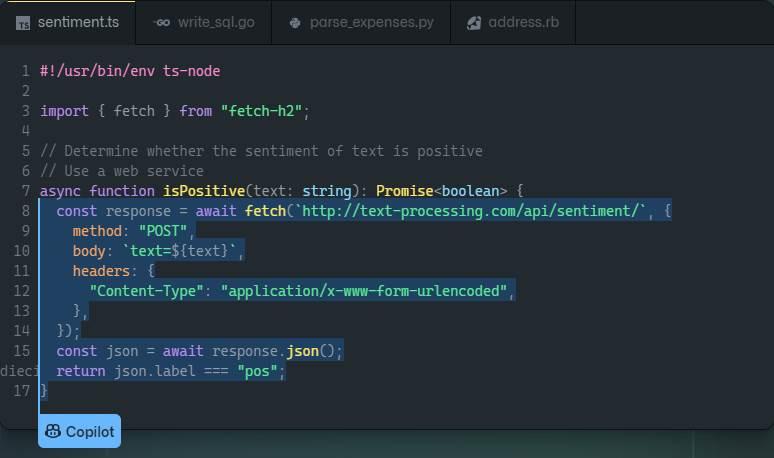

Visual Studio Code, el IDE de programación de Microsoft, consta ahora mismo de sistemas de auto-completar que nos permiten completar líneas de código de manera más o menos inteligente para ayudarnos en nuestro trabajo. Sin embargo, Copilot quiere revolucionar esto siendo capaz de escribir funciones completas a partir de las primeras líneas de código.

Copilot: un nuevo servicio inmoral e ilegal según la FSF

El problema de esta herramienta viene por la forma que ha usado Microsoft para enseñarla. Aunque el código que han compartido los usuarios en GitHub suele ser público, que una IA, diseñada con fines de lucro, lo analice sin permiso y lo use para auto-aprender, no ha gustado mucho a los usuarios.

Según la FSF, los desarrolladores quieren saber si es justo que una compañía, como GitHub o Microsoft, se aproveche de su trabajo, de su código, para entrenar a esta Inteligencia Artificial. También se preguntan si realmente es legal hacer lo que han hecho para entrenar la IA o podría ser una infracción de los derechos de autor.

Concretamente, las preguntas que quiere responder esta Free Software Foundation son las siguientes:

- ¿Usar repositorios públicos para entrenar la IA de GitHub Copilot es justo? ¿Infringe derechos de autor?

- ¿Podría generar reclamaciones por violar obras con licencia GPL?

- ¿Los programas generados con Copilot podrían cumplir con las licencias GPL?

- ¿Cómo pueden los desarrolladores estar seguros de que un código, protegido mediante derechos de autor, está realmente protegido de GitHub Copilot?

- Si Copilot genera un código que viola la licencia de un software libre, ¿cómo podría justificarse?

- ¿El código generado mediante la IA, o con Machine Learning, tiene derechos de autor?

- ¿Habría que cambiar la ley con la llegada de este tipo de servicios?

GitHub ha respondido a las críticas de la FSF expresando su voluntad de ser abierto ante cualquier tipo de problema, incluso ante los problemas morales. Pero no ha sido suficiente, y la Free Software Foundation quiere llegar hasta el final.

GitHub Copilot aún está en fase de pruebas

Por ahora, la nueva IA de Microsoft y GitHub está en fase de pruebas, y solo está disponible para un grupo muy pequeño de programadores. Si estamos interesados en probar este servicio podemos pedir acceso a Microsoft a través de este enlace y esperar a que nos llegue el turno de probar esta nueva IA.

En un principio, Microsoft va a ofrecer su servicio GitHub Copilot de forma totalmente gratuita. Sin embargo, dependiendo del éxito, es posible que veamos distintas ediciones de pago, aunque por ahora no sabemos las características que tendrán estas.

Lo que sí es seguro es que, para poder usarla, debemos tener un ordenador con hardware de gama alta y hacer uso de Visual Studio Code, el IDE de Microsoft.