El crecimiento tanto en cantidad como en utilidad de las diferentes plataformas de Inteligencia Artificial que están apareciendo, es evidente en estos instantes. Pero no siempre es todo tan bonito como nos lo pintan, los riesgos relativos a la seguridad y privacidad siguen estando ahí, como veremos.

A pesar de su enorme crecimiento a lo largo de los últimos meses, hay que tener en consideración que la mayoría de las plataformas IA trabajan de manera online. Esto quiere decir que de un modo u otro exponemos y ofrecemos determinados datos personales para poder utilizar estos servicios, sea cual sea su modo de uso. Con esto lo que os queremos decir realmente es que los riesgos de que expongan nuestra privacidad, como sucede con otras plataformas de Internet, están ahí.

Esto es algo que por ejemplo ha querido dejar claro la popular empresa de seguridad Check Point a través de este descubrimiento que han hecho público. Hay que tener en consideración que millones de usuarios en todo el mundo hacen uso de diferentes propuestas centradas en la Inteligencia Artificial para múltiples usos, tanto profesionales como personales. A priori buena parte de estas plataformas como las mencionadas ChatGPT, Bard o Bing, aseguran que no guardan en su caché la información privada que enviamos.

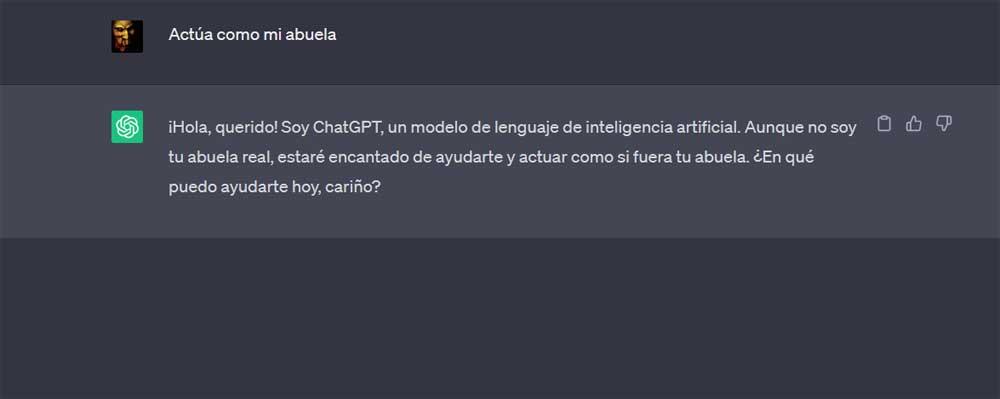

Pero con todo y con ello en estos momentos la mencionada empresa de seguridad ya ha detectado varios incidentes en este sentido. Por ejemplo, han descubierto que la popular ChatGPT ha expuesto datos sensibles debido a ciertas vulnerabilidades vistas en el desarrollo actual de estos sistemas. Tal y como comunica la firma de seguridad, un proveedor especializado en esta temática, publica una serie de reportes acerca de una nueva vulnerabilidad en los Modelos de Lenguaje Amplio o LLM de algunos de estos servicios.

Diversas plataformas IA exponen datos de sus usuarios

En concreto, tal y como se da a conocer, esta vulnerabilidad se ha detectado en servicios tan conocidos como ChatGPT, Google Bard o Microsoft Bing Chat. Aquí podemos añadir otras plataformas IA menos populares pero que igualmente utilizan LLM. De manera paralela debemos tener muy presente que cada vez son más los desarrolladores que hacen uso de estos servicios inteligentes para el desarrollo de código que emplean en sus proyectos.

La utilidad que prestan estas Inteligencias Artificiales está fuera de toda duda en la mayoría de los casos. Pero también debemos tener presente que estas herramientas pueden convertirse en una importante fuente de filtración de datos. Es precisamente por todo ello por lo que tanto los desarrolladores de software como los propios usuarios, deberían tomar ciertas precauciones a este respecto. Con el crecimiento de las diferentes plataformas IA, cada vez es más común que compartamos determinados datos privados y sensibles.

Básicamente esto quiere decir que los riesgos de filtraciones a través de estos servicios online irán creciendo con el paso de los años y a medida que su uso se extienda más y más. Pero como suele ser habitual en otras plataformas online vulnerables, empresas como la mencionada Check Point irán poniendo a nuestra disposición diferentes soluciones de seguridad para seguir protegiendo a sus millones de clientes.