OpenAI ha sido la última empresa tecnológica en revolucionar el mundo. Gracias a ella, la Inteligencia Artificial está al alcance de cualquier usuario, no solo a través de su propia herramienta (como es ChatGPT), sino también a través de otras muchas IAs (como Bing Chat) que se apoyan en esta misma Inteligencia Artificial. Aunque pensemos que ChatGPT es gratis, en realidad no es así. Pero, por suerte, a partir de hoy va a ser mucho más barato exprimir sus algoritmos.

ChatGPT tiene varias modalidades de pago. La primera de ellas es la modalidad gratuita, la que utiliza la mayoría de la gente, mucho más lenta y limitada que todas las demás, y que se basa en el algoritmo GPT-3.5 antiguo. A parte de esta modalidad, también tiene lo que se conoce como ChatGPT Plus, un modelo de suscripción muy caro que, a cambio de 20 dólares al mes, nos permite acceder a las últimas versiones del algoritmo (incluída GPT-4), mayor velocidad de resolución y acceso a las últimas funciones antes que nadie.

Pero, además de las dos opciones anteriores, OpenAI permite acceder a los algoritmos de ChatGPT mediante su API. El acceso a través de la API nos permite pagar en función de lo que usemos, pudiendo ajustar mucho más el precio y, rara vez, superando los 20 dólares al mes. La API se factura en función del número de tokens que gastemos. Cada algoritmo tiene un precio, y se calcula en función de cada 1000 tokens gastados. 1000 tokens, para hacernos una idea, son entre 700 y 800 palabras generadas mediante la IA.

Ahora, OpenAI ha decidido bajar el precio de los tokens para que los usuarios puedan generar más contenido por IA pagando menos. Eso sí, este cambios solo afecta a la versión GPT-3-5 Turbo del algoritmo. De esta forma, si queremos pagar por uso de la IA, el nuevo precio del algoritmo queda 0,0005 dólares por cada 1000 tokens generados, lo que supone una rebaja del 50% respecto al precio anterior.

Los demás algoritmos, por ahora, mantienen el mismo precio por API. Y, por desgracia, el precio de ChatGPT Plus no se ha visto afectado, teniendo que pagar los 20 dólares mensuales por acceder a él. Para hacernos a la idea, teniendo en cuenta el nuevo valor de los tokens, para gastar estos 20 dólares tendríamos que generar 30 millones de palabras dentro de ChatGPT al mes. De lo contrario, no sale rentable.

Cómo usar ChatGPT desde la API

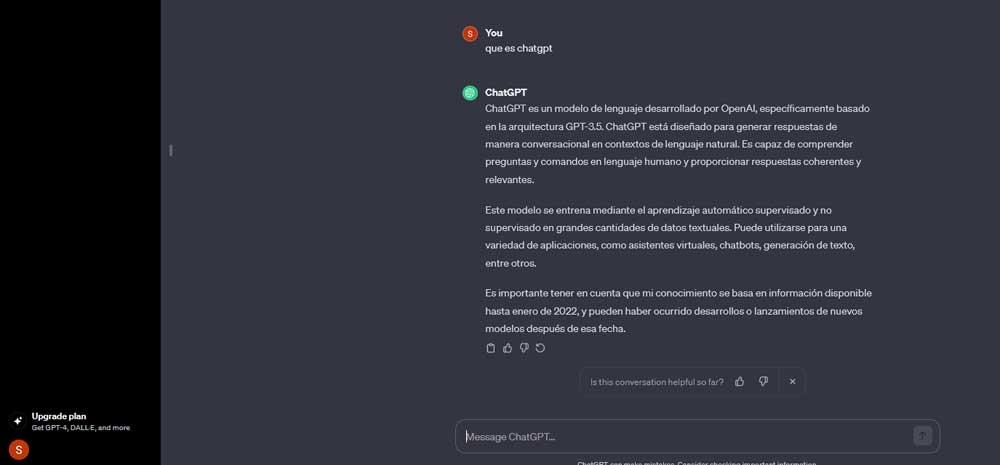

La pregunta que seguro que nos hacemos es cómo podemos aprovecharnos de estos nuevos precios. Aunque la API está pensada, sobre todo, para desarrolladores, cualquiera puede aprovecharse de ella de forma muy sencilla. Tan solo debemos entrar en la web de OpanAI, iniciar sesión, e ir al apartado de API.

Tras introducir nuestro método de pago (o recargar el monedero de ChatGPT), tendremos ya nuestra clave API. Ya solo nos falta buscar un programa, o extensión, que nos permita comunicarnos con ChatGPT a través de la API.

Nuevos algoritmos de IA para ChatGPT

Además de esta reducción de precio en los tokens para usar la IA mediante API, OpenAI también ha anunciado que está renovando muchos de los algoritmos que ya ofrece. El primero de ellos lo veremos reflejado en el propio GPT-3.5 Turbo del que ya hemos hablado. Y es que, tal como asegura la compañía, ahora ofrecerá respuestas mucho más directas y precisas, además de solucionar un problema de codificación de texto cuando se interactuaba con idiomas diferentes al inglés.

GPT-4 también va a mejorar considerablemente, y es que su nueva preview ahora puede usar muchos más caracteres dentro del contexto del chat (hasta 128.000) para generar mejores respuestas y mejor código si se usa para programar. Una versión de GPT-4 Turbo ya está en marcha, y debería llegar, como muy tarde, de cara a verano. Esta versión, entre otras cosas, elimina los casos de «pereza» en los que el algoritmo decide dejar de procesar peticiones a la mitad, mejorando la precisión general de los chats.

Además, también se ha anunciado el lanzamiento de GPT-4 Vision, un nuevo algoritmo que llegará también muy pronto aunque, de momento, no sabemos gran cosa de él.