Así nos avisará YouTube si un vídeo se ha creado con una IA para evitar confusiones

Los diferentes formatos de plataformas centradas en la Inteligencia Artificial están llegando a todo tipo de contenidos y aplicaciones. Como no podía ser de otro modo, esto alcanza a los vídeos que por ejemplo podemos encontrar en Internet, por lo que Google está tomando cartas en el asunto en lo que se refiere a YouTube.

De hecho, muchos creadores de contenidos centrados en las imágenes están poniendo el grito en el cielo debido a los plagios que sufren por estas IA. De ahí que de manera sutil se estén añadiendo marcas de agua para evitar estas copias descaradas de contenidos. Asimismo, ya empiezan a generarse las dudas de manera generalizada acerca de si determinadas fotos o vídeos que vemos son reales o creadas por una de estas plataformas generativas automáticas.

Son muchas las aplicaciones que nos ayudan a crear estos contenidos en cuestión de segundos tales como DALL-E o Bing Image, entre otras muchas propuestas. De igual modo están apareciendo algunas herramientas especialmente desarrolladas para generar sus propias falsificaciones. El principal objetivo de estas es engañar a la gente haciéndoles creer que son, por ejemplo, vídeos reales filmados de manera convencional.

De ahí precisamente que en estos instantes Google quiera poner solución a todo ello en su popular portal de vídeos en streaming, YouTube. Por todo acaba de hacer un importante anuncio en este sentido y que poco a poco irá llegando a todo el. Os contamos todo esto porque la empresa de las búsquedas ha anunciado que planea ayudar a los usuarios del sitio web, a saber, si un vídeo que están reproduciendo se ha creado con alguna herramienta IA generativa.

Medidas de YouTube para detectar vídeos creados por IA

Hay que decir que en primer lugar Google exigirá a los creadores que revelen si han publicado contenidos alterados con aspecto realista y con el uso de herramientas IA. De este modo, cuando suban ese contenido, tendrán la posibilidad de indicar que ese vídeo contiene material realista alterado o creado con estas herramientas. Podría ser un vídeo generado por IA que represente de forma realista un suceso que nunca ocurrió. Aquí también entraría en juego un contenido que muestre a alguien haciendo algo que no fue real.

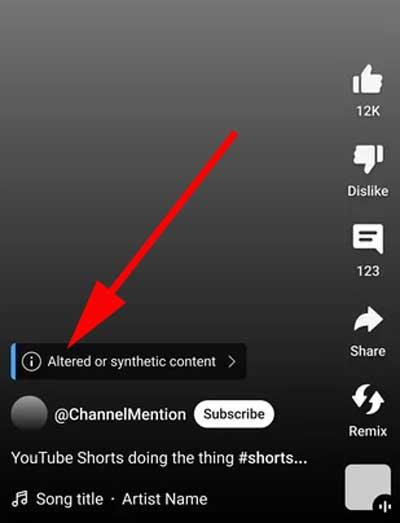

Toda esa información adicional se llevará a cabo a través de una serie de etiquetas que se añadirán al panel de descripción del vídeo. De este modo nos encontraremos con marcas por si un vídeo de este tipo trata lo que Google considera como temas delicados. La propia etiqueta se añadirá directamente al reproductor como tal. Todo ello se hará extensible para los contenidos generados con los propios productos de IA generativa de la misma YouTube.

Esta información adicional para los usuarios de YouTube será obligatoria por parte de los creadores de contenidos cuando suban vídeos de estas características. De hecho, tal y como nos informa Google, los que no pongan estas etiquetas cuando sea necesario en sus vídeos, podrían ver cómo sus publicaciones se borran o incluso se podría cerrar sus cuentas. Igualmente se pondrá a disposición de los usuarios una manera de solicitar la eliminación de un vídeo creado por IA que simule a una persona conocida. Esta medida será muy útil para los plagios musicales que repliquen las voces de los cantantes.

Y si estos vídeos infringen las políticas del sitio web streaming, se eliminarán, aunque estén debidamente etiquetados como creados por IA. Esto es algo que poco a poco irá llegando a lo largo de los próximos meses.