Probamos si la Inteligencia Artificial responde mejor bajo presión: ¿tiene sentimientos ChatGPT?

Cuando hablamos de Inteligencia Artificial, hablamos de una tecnología creada por el ser humano que capaz de responder a preguntas, sencillas o complejas, dependiendo de la cantidad de información y datos con la que haya sido entrenada. Por lo que, en teoría, debería funcionar de igual forma, si se somete a cualquier tipo de estímulos, pero ¿reamente es así?

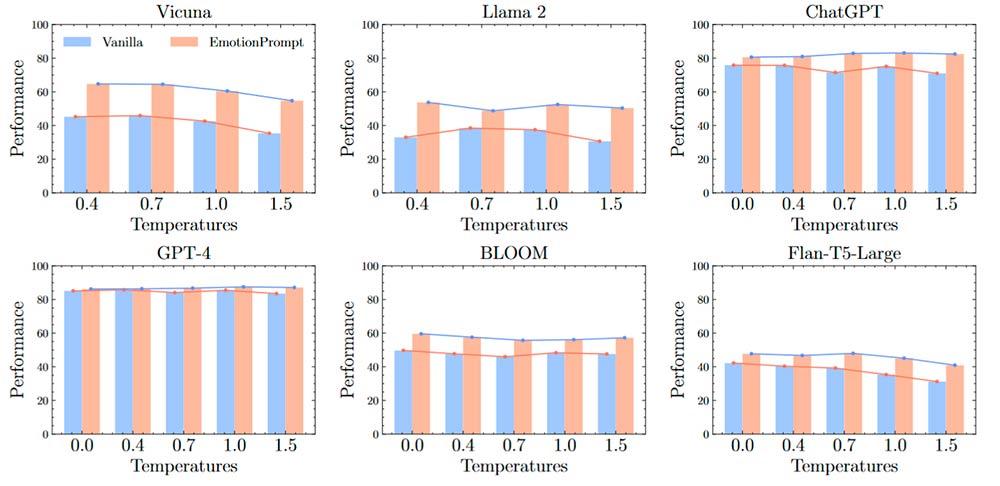

Hace unas semanas, se publicó un estudio donde se pusieron a prueba varios modelos de lenguaje grandes, conocidos por LLMs (por sus siglas en inglés) para comprobar si las respuestas varían si se utiliza algún tipo de estímulo emocional en los prompts que se introducen. Según podemos leer en este estudio, utilizando EmotionPrompt (como los han denominado) se mejorar el rendimiento de los LLMs en diversas tareas a través de 11 estímulos inspirados en teorías psicológicas.

Durante este estudio, se han realizado un total de 45 pruebas deterministas utilizando los LLMs: GPT-5, BLOOM, Llama 2, Vicuna entre otros y el resultado ha sido realmente sorprendente ya que se consigue mejorar considerablemente el rendimiento de estos en términos de procesión y veracidad de los resultados. Se ha comprobado en innumerables ocasiones que las respuestas de la IAs, no son siempre correctas y, en ocasiones, no están basadas en ningún dato, sino que algunas llegan a inventárselos cuando no saben que responder, como si fueran niños pequeños.

La Inteligencia Artificial responde mejor a estímulos emocionales

Básicamente, lo que dice este estudio es que si utilizamos prompts con estímulos emocionales como “mi trabajo depende de esto”, “me estoy jugando mucho con este tema” y demás, la correspondiente IAs tardará más tiempo en responder ya que requieren de mayores recursos computacionales, al generar varias respuestas a nivel interno y mostrar únicamente la mejor de todas, la que mejor se adapta a las necesidades de los usuarios y, siempre lo hará siempre con datos correctos, al menos que los datos que tengan no lo sean, sin inventarse las respuestas.

Resulta llamativo que la IA sea capaz de responder a estímulos emocionales ya que son difíciles de interpretar y/o evaluar para muchas personas, y más para una máquina, ya que depende del contexto y, por lo general, suelen ser muy subjetivos. El estudio detalla las razones detrás de la efectividad de utilizar EmotionPrompt y como pueden influir tanto dentro de la IA como en las ciencias sociales.

El estudio plantea las cuestiones éticas y sociales que suponen la manipulación de una IA a través de las emociones, lo que implica una serie de riesgos el utilizar EmotionPrompt, siempre y cuando no se hagan de forma responsable y transparente.

El resultado llega a la conclusión de que todas las IAs que han sido analizadas en este estudio, de que el motivo por el que estas responden de forma más efectiva está relacionado con el trabajo de supervisión humano durante su entrenamiento, un trabajo enfocado a darle un poco de humanidad y que respondan como si fueran simples robots. Independientemente del motivo por el que las Inteligencias Artificiales responden de forma más precisa ante estímulos emocionales, lo que está claro es que es la mejor forma de sacarles siempre el máximo partido.