Cuidado con las palabras que usas al crear imágenes con IA, Microsoft ya toma medidas

Las diferentes plataformas IA que muchos de vosotros utilizáis tanto desde el ordenador de sobremesa como desde el móvil, nos permiten generar ciertos contenidos de forma automática. En un principio se popularizaron gracias a la creación de textos con tan solo introducir una serie de términos clave. Pero esto se ha extendido a otros elementos como las imágenes o incluso los códigos de programación.

Tenemos al alcance de la mano una enorme cantidad de plataformas y aplicaciones centradas en este tipo de tareas. Además, su número y potencial no para de crecer gracias a los nuevos modelos de lenguaje que van apareciendo con el tiempo. Pero claro, como era de esperar, algunos usuarios intentan beneficiarse de estos elementos de aprendizaje automático para usos no del todo lícitos.

De ahí que muchas empresas estén controlando los textos que sus trabajadores les hacen llegar, al igual que sucede con los profesores en el sector de la educación. Sin embargo, en estas líneas nos vamos a centrar en todo aquello que se refiere a las imágenes. Con tan solo teclear unas palabras en forma de prompt, tenemos la posibilidad de generar espectaculares imágenes en segundos. Todo ello gracias a la Inteligencia Artificial.

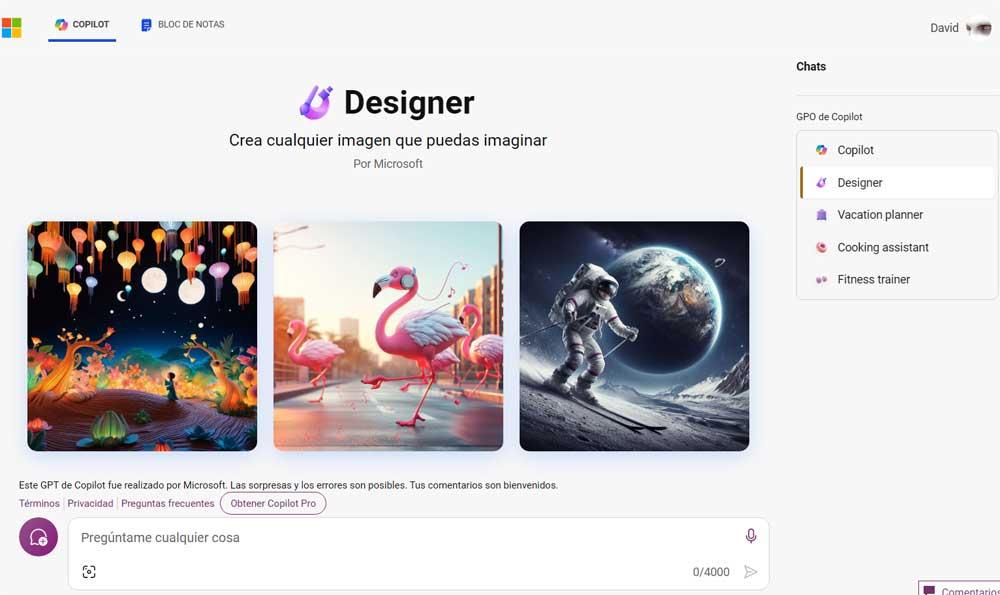

Precisamente por esto que os contamos, algunas empresas ya están empezando a imponer una serie de filtros y límites en sus plataformas de este tipo. Un ejemplo de todo ello lo encontramos en Microsoft con su Copilot Designer. La principal razón de todo ello es que están detectando usos poco ortodoxos a la hora de crear ciertas imágenes específicas usando su IA.

Medidas de Microsoft contra el mal uso de la IA

Esta es una de las principales razones por las que el gigante del software está implementando ahora mismo una serie de filtros en su plataforma Inteligencia Artificial. En concreto nos referimos hora mencionada Copilot Designer que se centra en la creación de imágenes de todo tipo.

El principal objetivo de estos filtros, os comentamos, es evitar que los usuarios puedan crear fotos de carácter violento o sexual, entre otros temas inapropiados. También se están estableciendo limitaciones y términos prohibidos para evitar que los usuarios puedan crear ciertas imágenes explícitas poco recomendables en cuanto a su temática. De hecho, al intentar utilizar estos términos que os comentamos, en pantalla aparecerá un mensaje de advertencia.

De este modo quedará patente la violación de las políticas de uso de la Inteligencia Artificial a la hora de generar estos contenidos gráficos. Cabe mencionar que este cambio ha venido dado por varias razones. En primer lugar, la preocupación ha crecido mucho en los últimos tiempos tras la avalancha de fakes de la cantante Taylor Swift que han aparecido últimamente creadas en Copilot Designer.

Además, y de manera paralela, también ha influido la preocupación de uno de sus ingenieros, Shane Jones. Este compartió su preocupación tanto con la Comisión Federal de Comercio de EE.UU. como con la junta directiva de Microsoft acerca de la creación de ciertos contenidos usando esta IA. Teniendo en consideración el enorme crecimiento que estas plataformas están teniendo, si no se toman ciertas medidas, la cosa podría ir a más y a peor.

Así, es de esperar que estos filtros y bloqueos a la hora de generar determinadas imágenes automáticas se extienda en la mayoría de las plataformas de este tipo.